Warum die eigentliche Transformationsfrage nicht technisch ist

In den Sozialen Medien tobt ein Stellungskrieg. Auf der einen Seite die KI-Propheten, die mit Apokalypse-Timelines ihre Reichweite maximieren. Auf der anderen Seite die Pragmatiker, die aus der Praxis berichten: Ja, KI verändert die Arbeit – aber anders, als die Headlines suggerieren. Erfahrene Enterprise Architekten beschreiben, wie sie mit Claude Code produktiver arbeiten als je zuvor – und gleichzeitig darauf hinweisen, dass ihr Domänenwissen und ihre Architekturerfahrung die Voraussetzung für diese Produktivität sind, nicht deren Opfer (1). Ich bin kein Freund von pauschalisierten Antworten die nur die Extrema von möglichen Perspektiven adressieren. Modellbildung muß immer mit Zweck und Kontext abgeglichen werden. Schauen wir uns deshalb das KI-Thema differenziert an.

Wird KI Tätigkeiten ersetzen, die heute von Menschen ausgeübt werden? Ja. Das tut sie bereits, und sie wird es in zunehmendem Umfang tun. Routineanalysen, Texterstellung, Codezeilen, Datenaufbereitung – überall dort, wo kognitive Arbeit wiederholbar und musterbasiert ist, übernimmt KI schneller und günstiger. Das zu leugnen wäre naiv.

Wird KI Menschen überflüssig machen? Nein – aber sie wird die Definition von Wert verschieben. Was gestern als Expertise galt (das Wissen, wie man etwas tut), wird zur Commodity. Was morgen zählt, ist Urteilsvermögen: zu wissen, was getan werden sollte, warum, und ob das Ergebnis stimmt. Und das erfordert fachliche Kompetenz und Erfahrung. Die Tätigkeit verschwindet, die Verantwortung bleibt. Und Verantwortung lässt sich nicht automatisieren.

Wird KI eine Arbeitslosenwelle erzeugen? Wahrscheinlich nicht in dem Umfang, den die Apokalyptiker predigen – aber die Übergänge werden schmerzhaft sein, wenn sie nicht gestaltet werden. Das Jevons-Paradoxon (dazu gleich mehr) deutet darauf hin, dass effizientere kognitive Leistung mehr Arbeit erzeugt, nicht weniger. Aber die Art der Arbeit wird sich verändern, und wer nicht lernt und befähigt wird, fällt durch das Raster. Die Frage ist nicht, ob es genug Arbeit gibt, sondern ob wir die Menschen rechtzeitig darauf vorbereiten.

Wird KI die Arbeit von Menschen optimieren oder verdichten? Beides – und genau hier liegt die Gefahr. Optimierung heißt, mit gleichem Aufwand bessere Ergebnisse zu erzielen. Verdichtung heißt, mit gleichem Output weniger Menschen zu beschäftigen. Die Entscheidung zwischen beiden ist keine technische, sondern eine der Führung. Wer auf Verdichtung setzt, gewinnt kurzfristig Marge und verliert langfristig Tragfähigkeit. Wer auf Optimierung setzt, investiert in die Fähigkeit, Komplexeres zu bewältigen.

Wer trägt die Verantwortung, wenn die KI falsch liegt? Nicht die KI – die kann keine Verantwortung tragen. Das erinnert mich an Pressemeldungen wo Autofahrer ihr Auto in Gräben, Kanäle und Co. manövriert haben, weil sie stumpf dem GPS folgten. ohne Kontext und Verstand zu benutzen (13). Jemand muss die Verantwortung übernehmen. Aber wer, wenn der Mensch mit dem Wissen längst gegangen ist? Wer versteht noch, was das System tut und warum? Wer kann eingreifen, wenn es schiefgeht?

Haben wir die Architektur, die das alles tragen kann? Das ist die Frage dieses Artikels. Und die aktuelle Antwort ist in den meisten Organisationen: Nein.

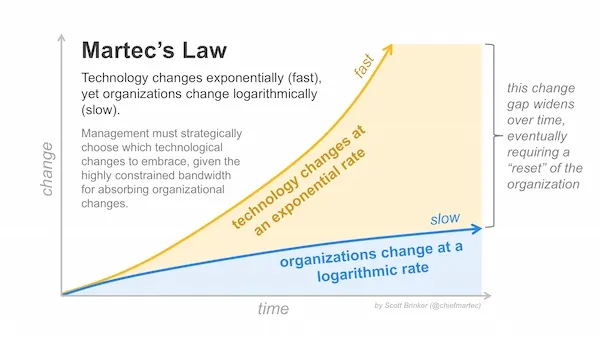

Martec's Law und die neue Schallmauer

Scott Brinker hat 2013 ein Gesetz formuliert, das seitdem immer relevanter wird: Technologie verändert sich exponentiell, Organisationen logarithmisch (2). Die Schere zwischen beiden wird größer, nicht kleiner. Und irgendwann muss jede Organisation einen Reset machen – eine bewusste Neuausrichtung, um den Gap nicht zur Kluft werden zu lassen.

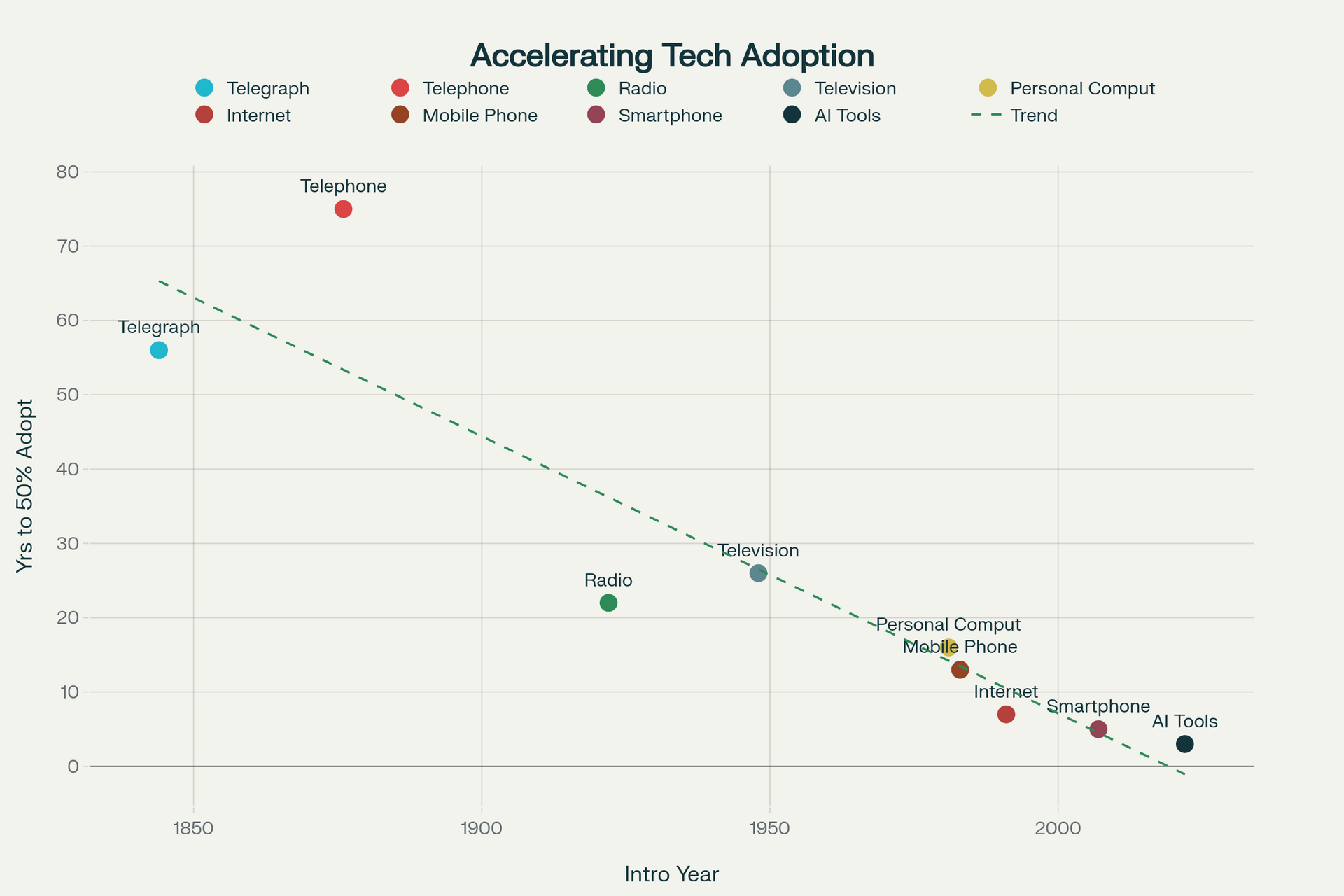

KI ist nicht einfach die nächste Technologiewelle. Sie ist eine neue Schallmauer der Veränderungsdynamik und Technologieadaption und hat die Größte jemals gemessene Adaptionsrate. Keine Technologieadoptionskurve war je so steil. Und keine hat so direkt in die kognitive Wertschöpfung eingegriffen – also in das, was Wissensarbeiter zu Wissensarbeitern macht (14).

Der Reflex der meisten Organisationen: schneller werden. Schneller implementieren, schneller automatisieren, schneller die Effizienzgewinne einfahren. Und ebenfalls die Schnelligkeit als Mehrproduktivität oder Effizienzgewinn durch Delegation einfordern.

Das Gen-AI-Paradoxon: Die Daten bestätigen den Befund

McKinseys QuantumBlack-Report „Seizing the Agentic AI Advantage" (15) liefert die empirische Unterfütterung für genau diesen Reflex – und sein Scheitern. Die Zahlen sind ernüchternd: 78 Prozent der Unternehmen setzen bereits generative KI ein. Gleichzeitig berichten über 80 Prozent von keinem messbaren Beitrag zum Unternehmensergebnis. Nur 1 Prozent der befragten Unternehmen betrachten ihre KI-Strategie als ausgereift. McKinsey nennt das den „Gen AI Paradox" – für all die Energie, Investitionen und das Potenzial, das die Technologie umgibt, hat sich der Effekt im Maßstab für die meisten Organisationen noch nicht materialisiert.

Im Kern des Paradoxons liegt ein Ungleichgewicht, das direkt auf die Architektur-Frage verweist. „Horizontale" Use Cases – unternehmensweite Copilots, Chatbots, interne Q&A-Assistenten – wurden schnell ausgerollt, liefern aber diffuse, schwer messbare Verbesserungen. Sie erhöhen die individuelle Produktivität, skalieren aber selten über die Organisation. Die wirklich transformativen „vertikalen" Use Cases – funktionsspezifisch, tief in die Wertschöpfung integriert – stecken zu 90 Prozent in der Pilotphase fest. Der Grund: technische, organisationale, datenbezogene und kulturelle Barrieren. Mit anderen Worten: mangelnde Architektur.

Das ist Martec's Law im realen Leben. Die Technologie ist exponentiell gewachsen, aber die organisationale Fähigkeit, sie sinnvoll einzubetten, hinkt logarithmisch hinterher. Der Aktionismus – schnell Tools ausrollen, schnell Copilots einführen – erzeugt Bewegung, aber keine Wirkung.

Aber Geschwindigkeit ohne Architektur erzeugt mehr Reibungswiderstand (engl. Drag), nicht Momentum. Tony Lockwood formuliert es im Transformation Leaders Body of Knowledge (TLBoK) so: „Speed without architecture creates drag later. Architecture without courage creates analysis paralysis. But architecture with authority creates momentum that sustains" (5). Drag kommt aus der Physik und Aerodynamik. Es ist der Widerstand, der ein Objekt ausbremst. Wenn ein Flugzeug schlecht designt ist, erzeugt es bei höherer Geschwindigkeit mehr Luftwiderstand statt mehr Vortrieb. Übertragen auf Organisationen: Wer schnell transformiert, ohne die Architektur (also Strategy, Operating Model, Governance, Capabilities) mitzuziehen, erzeugt mit jedem Tempo-Schritt mehr internen Widerstand. Technische Schulden, ungeklärte Verantwortlichkeiten, überforderte Teams – das alles ist Drag. Je schneller man wird, desto stärker bremst es. Momentum ist das Gegenteil: Schwung, der sich selbst trägt. Ein gut designtes System gewinnt mit der Zeit an Fahrt, weil jede Veränderung die nächste durch Skalierung erleichtert statt sie zu behindern.

Das Jevons-Paradoxon: Mehr, nicht weniger

Bevor wir über Architektur sprechen, müssen wir einen Denkfehler auflösen, der die gesamte KI-Debatte vergiftet. Die meisten Diskussionen gehen davon aus, dass KI Arbeit ersetzt. Wer das glaubt, sollte sich mit William Stanley Jevons beschäftigen. 1865 beobachtete Jevons, dass effizientere Dampfmaschinen nicht zu weniger Kohleverbrauch führten, sondern zu mehr (6). Warum? Weil die Effizienzsteigerung neue Anwendungsfelder erschloss, die vorher unwirtschaftlich waren. Mehr Maschinen, nicht weniger. Mehr Kohle, nicht weniger.

Übertragen auf KI heißt das: Kostengünstigere kognitive Leistung ermöglicht Unternehmen, signifikant mehr Projekte, Experimente und Nischenideen umzusetzen, die bisher schlicht unwirtschaftlich waren. Das Ergebnis ist nicht weniger Wissensarbeit, sondern mehr. Nicht weniger Entwickler, sondern Entwickler, die die Wirkung von fünfzig erzielen – wenn sie richtig befähigt werden (7).

McKinseys Praxisbeispiele bestätigen diesen Mechanismus: Eine globale Bank verkürzte ihre IT-Modernisierungszeitlinien um über 50 Prozent, indem sie Agenten zur Unterstützung der Engineering-Teams einsetzte – nicht um Engineers zu ersetzen, sondern um ihre Wirkung zu vervielfachen. Ein Finanzinstitut restrukturierte seinen Credit-Memo-Prozess und erzielte einen Produktivitätsgewinn von 60 Prozent für die Analysten. Und ein weiteres Unternehmen nutzte Multi-Agenten-Systeme zur Bereinigung und Interpretation komplexer Marktdaten, mit projizierten Einsparungen von 3 Millionen Dollar jährlich (15). In keinem dieser Fälle wurden die Fachleute ersetzt. Sie wurden befähigt, Wirkung zu entfalten, die vorher jenseits ihrer Kapazitätsgrenze lag. Das ist Jevons in Aktion.

Die richtige Frage ist nicht: „Wie ersetze ich fünf Entwickler durch KI?" Die richtige Frage ist: „Wie befähige ich fünf Entwickler, die Wirkung von fünfzig zu erzielen?" Und diese Frage ist eine Architektur-Frage.

Function follows form – die stille Sabotage

Tony Lockwood beschreibt im TLBoK vier Architekturschichten, die in jeder Organisation kohärent zusammenwirken müssen (5): Strategy gibt Richtung. Das Operating Model stellt sicher, dass die Organisation diese Richtung strukturell umsetzen kann. Governance klärt, wer welche Entscheidungen trifft. Und Capabilities sind die Fähigkeiten, die das System braucht, um Wert zu liefern.

Es sollte eigentlich meist das folgende architektonische Grundprinzip: Form follows function – die Gestalt leitet sich aus dem Zweck ab. Wenn eine Strategie ein Ziel setzt, dann bestimmt dieses Ziel, welche Fähigkeiten das System braucht, und daraus ergibt sich, wie Strukturen, Prozesse und Entscheidungswege gestaltet sein müssen.

In realen Veränderungsdynamiken gilt aber fast überall das Gegenteil. Function follows form. Nach diesem Prinzip zu arbeiten macht Sinn, wenn man explizit neue Dynamiken erzeugen will, z.B. bei aktiv kultureller Veränderung. Aber man ist schlecht beraten, wenn man das Prinzip unreflektiert verwendendet. Das passiert die Veränderung der Strategie einer Organisation mit „Wir setzen auf KI!" – läßt aber das Operating Model unangetastet. Die bestehende Struktur filtert dann still, welche Fähigkeiten überhaupt entwickelt werden können. Die Strategie sagt „wir brauchen X", aber das System ist gebaut, um Y zu liefern. Execution wird schwer, nicht weil die Menschen versagen, sondern weil die soziotechnologische Architektur nicht mitgezogen wurde.

McKinseys Befund zum Horizontal-Vertikal-Ungleichgewicht beschreibt diese stille Sabotage. Die horizontalen Copilots wurden schnell ausgerollt, weil sie keine architektonischen Änderungen erfordern – sie legen sich über bestehende Strukturen wie eine Schicht, ohne sie zu berühren. Die vertikalen Use Cases hingegen – jene, die tief in funktionsspezifische Wertschöpfung eingreifen – scheitern zu 90 Prozent am Pilotstadium, weil sie genau diese strukturelle Anpassung verlangen: veränderte Prozesse, geklärte Verantwortlichkeiten, angepasste Governance. Die Strategie sagt „vertikale Transformation", aber das Operating Model liefert „horizontale Commoditisierung". Function follows form, mit 90-Prozent-Steckenbleiber-Quote als Beleg.

Das ist das Scheitern, welches in fast jeder KI-Transformation wirkt. Es werden KI-Tools eingeführt, Prompt-Engineering-Workshops veranstaltet, vielleicht sogar ein „Chief AI Officer" installiert – aber das Operating Model bleibt dasselbe. Die Governance-Strukturen bleiben dieselben. Die Teamtopologien bleiben dieselben. Und dann wundert man sich, warum die Transformation nicht die erhofften Ergebnisse liefert.

Die dreifache Legacy-Falle

Wer KI ohne architektonische Kohärenz einführt, erzeugt eine neue Form von Legacy, die gefährlicher ist als alles, was wir bisher kannten (8). In praktisch allen Unternehmen gibt es irgendwelche Alt-Server oder Einzelrechner, die irgendetwas am Laufen halten – den Drucker in der Produktionsinsel, das Kundenstammsystem in COBOL im Serverraum. Das ist technische Legacy im klassischen Sinne: veraltete geschäftskritische Systeme, die niemand mehr anfassen will.

KI erzeugt eine dreifache Legacy: Technische Legacy 2.0 ist die KI-spezifische Variante. Workflows, die auf KI-Modellen basieren, deren Verhalten sich ändert, deren Entscheidungslogik intransparent ist, deren Wartung und Validierung niemand eingeplant hat. Der entscheidende Unterschied zur klassischen Legacy: Bei Legacy 1.0 können wir theoretisch den Code lesen und verstehen. Bei Legacy 2.0 verstehen wir nicht einmal, warum das Modell von 2024 diese Entscheidung traf – weil es ein anderes Modell war als das von heute. Ein etablierter ISO-Prozess liefert morgen gesichert dasselbe Ergebnis. Ein LLM-Skill möglicherweise nicht.

McKinsey adressiert genau diese Gefahr mit dem Konzept des „Agentic AI Mesh" – einem neuen Architektur-Paradigma für die Governance einer sich rapide entwickelnden organisationalen KI-Landschaft (15). Der Mesh ist die Antwort auf die Frage: Wie orchestrieren wir eine wachsende Armee autonomer Agenten, ohne die Kontrolle zu verlieren? Die Designprinzipien des Mesh – Composability (Werkzeuge, Modelle oder Agenten können hinzugefügt werden, ohne das Kernsystem zu verändern), Distributed Intelligence (Agenten koordinieren und teilen Aufgaben über Netzwerke), Layered Decoupling (Logik, Speicher, Orchestrierung und Interface werden in Schichten entkoppelt) und Vendor-Neutralität – adressieren exakt die technische Legacy-2.0-Problematik. Ohne eine solche Architektur wächst mit jedem neuen Agenten das Risiko unkontrollierbarer technischer Schulden. Aber: Der Mesh allein löst nur die technische Dimension. Die organisationale und menschliche Legacy bleibt davon unberührt – und genau hier liegt der Gap, die über reine Technologie-Architektur hinausweist.

Organisationale Legacy entsteht, wenn das Wissen in den Köpfen derer verschwindet, die gegangen sind. Verantwortungsketten, die im Organigramm enden, aber nicht in der Realität. Prozesse, die funktionieren – bis sie es nicht mehr tun, und dann weiß niemand mehr, warum sie überhaupt so aufgesetzt wurden. Wer führt die KI-Leiharbeiter? Die IT wird es nicht sein können, weil Geschäftsprozesse einen Owner im Business brauchen. Die fachliche Beurteilung der Leiharbeiter-Ergebnisse muss im Fachbereich liegen.

Identitäts-Legacy ist die am wenigsten diskutierte und vielleicht wirkungsvollste Form. Menschen, die ihre Kompetenz als Identität verstanden haben. Die jetzt nicht wissen, wer sie sind, wenn die KI „ihren Job" macht. Eine Generation von Fachexperten, deren Selbstwert erschüttert wurde, bevor jemand ihnen half, neue Quellen für Bedeutung zu finden.

Alle drei Formen von Legacy entstehen aus demselben Grundfehler: Geschwindigkeit ohne Architektur. Tools einführen, ohne das Operating Model anzupassen. Tätigkeiten automatisieren, ohne die Governance zu klären. Experten ersetzen, ohne ihre Nachfolger auszubilden.

Drei Achsen, ein System

Was wäre die Alternative? Wie sieht eine KI-Transformation aus, die architektonisch denkt statt aktionistisch handelt? Mein Arbeitsbuch zu "Zeitlos Verwurzelt" - noch unveröffentlicht wird "Zeitlos Handeln" heißen. In ihm habe ich in Kapitel 6.10 ein Drei-Achsen-Modell entwickelt, das genau diese Frage beantwortet (9). Es verbindet drei architektonisch modellbildende Perspektiven, die einzeln jeweils nur einen Teil der Geschichte erzählen:

Die erste Achse ist die organisationale Architekturdimension nach Lockwoods TLBoK (5): Von der Strategie über das Operating Model und die Governance bis zu den Capabilities muss jede Schicht kohärent sein. Die Frage hier ist: Was muss strukturell stimmen, damit Transformation gelingen kann? McKinseys Vier-Säulen-Modell als komplementäre Linse: McKinseys Report formuliert vier Enabler-Dimensionen für erfolgreiche Agentic-AI-Transformation: People, Governance, Technology und Data (15). Auf den ersten Blick ähneln sie Lockwoods Architekturschichten – und tatsächlich sind sie komplementär, nicht konkurrierend. Lockwoods Modell fragt: Wie muss die Gesamtarchitektur der Organisation kohärent aufgebaut sein? McKinseys Vier Säulen fragen: Was sind die konkreten Enabler, die innerhalb dieser Architektur aktiviert werden müssen? Die People-Säule verlangt neue Rollen und Fähigkeiten – nicht nur technische, sondern auch die Fähigkeit von Managern, zu entscheiden, wann sie Agenten vertrauen, und von Führungskräften, das Gesamtsystem im Blick zu behalten. Die Governance-Säule adressiert die Frage, die bei Hunderten autonomer Agenten, die Entscheidungen treffen, existenziell wird: Wer hat sie gebaut, was dürfen sie, und wie werden sie überwacht? Die Technology-Säule fordert eine modulare und resiliente Infrastruktur – das, was der Agentic AI Mesh auf der technischen Ebene bereitstellt. Und die Data-Säule verlangt den Shift von use-case-spezifischen Datenpipelines zu wiederverwendbaren Datenprodukten. Für das Drei-Achsen-Modell bedeutet das: McKinseys Enabler-Dimensionen lassen sich als operative Konkretisierung der organisationalen Architekturdimension lesen. Sie beantworten die Frage, was innerhalb der Lockwood-Schichten tatsächlich in Gang gesetzt werden muss, damit Agentic AI nicht im Pilotfriedhof steckenbleibt.

Die zweite Achse ist die technologische Architekturdimension, wie sie Susanne Kaiser in Architecture for Flow beschreibt (10). Wardley Mapping zeigt, wo Capabilities in ihrer Evolution stehen – was neu und unsicher ist, was standardisiert und stabil. Eine Capability in der Genesis-Phase braucht explorative Strukturen mit viel Autonomie. Eine Commodity-Capability braucht Effizienz und Standardisierung. Wenn du eine entstehende Fähigkeit in ein standardisiertes Operating Model zwängst, erstickst du sie. Function follows form in Reinkultur. McKinseys Unterscheidung zwischen horizontalen und vertikalen Use Cases bildet sich hier direkt auf die Wardley-Logik ab: Horizontale Copilots sind Commodity-nahe Capabilities – sie funktionieren in standardisierten Operating Models, weil sie keine tiefe Integration erfordern. Vertikale, funktionsspezifische Agenten hingegen befinden sich in der Genesis- oder Custom-Built-Phase: Sie müssen explorativ entwickelt, tief in fachliche Prozesse eingebettet und iterativ validiert werden. Wer beide gleich behandelt – mit denselben Governance-Strukturen, denselben Rollout-Playbooks, denselben Erfolgskennzahlen – erzeugt exakt das Scheitern, das McKinseys 90-Prozent-Pilotfriedhof-Statistik dokumentiert.

Die dritte Achse ist die menschliche Tiefendimension – und sie ist der Grund, warum das Buch "Zeitlos Verwurzelt" existiert. Selbst wenn du Form follows function sauber umsetzt, die Architektur aus dem Zweck ableitest und das Operating Model zur Strategie passt, bleibt die Frage: Können die Menschen diese Form tragen?

Ein Operating Model, das Autonomie und Entscheidungsmut verlangt, funktioniert nicht in einer Kultur, die von Absicherung und Kontrolle geprägt ist. Ein Governance-Framework, das auf Vertrauen setzt, scheitert, wenn Vertrauen nie gewachsen ist. Dann hast du Form follows function auf dem Papier – aber "Culture eats structure for breakfast" in der Praxis. McKinseys Report benennt diese Dimension als „the hardest part" – und räumt ihr dennoch den geringsten Raum ein (15). Die People-Säule spricht von neuen Rollen, Skills und der Notwendigkeit, dass Teams lernen, „alongside agents" zu arbeiten. Aber sie adressiert nicht die tiefere Frage: Ob Menschen bereit sind, diese neue Form der Zusammenarbeit innerlich zu tragen. Die Fähigkeit, einem autonomen Agenten Entscheidungen zu delegieren und gleichzeitig die Verantwortung für das Ergebnis zu behalten – das ist kein Skill, den man in einem Workshop lernt. Das ist eine Haltung, die in der Identität verankert sein muss. Genau hier liegt der blinde Fleck, den das Drei-Achsen-Modell schließt: Die dritte Achse – die menschliche Tiefendimension, das H.E.A.R.-Framework meines Buches "Zeitlos Verwurzelt" – adressiert das, was McKinseys Report als das Schwierigste identifiziert, aber nicht auflöst.

Jede Architekturschicht hat eine menschliche Voraussetzung

Das Drei-Achsen-Modell macht sichtbar, was in rein technischen oder rein strukturellen Transformationsansätzen fehlt um das Gap zur technologischen und organisationalen Exzellenz zu schließen: Jede Architekturschicht hat eine menschliche Voraussetzung, die sich nicht designen lässt – sie muss wachsen.

Die Strategieschicht braucht innere Klarheit und echtes Buy-in, nicht verordnete Zustimmung. Wenn Führungskräfte die Strategie nicht in eigenen Worten formulieren können, ist sie nicht verstanden. Wenn sie sie nicht innerlich mittragen, wird sie sabotiert – meist unbewusst, durch Priorisierungsentscheidungen im Alltag. McKinsey formuliert diesen Punkt als CEO-Imperativ: Der Pivot von Experimentation zu institutionellem Commitment sei eine Entscheidung, die nur der CEO treffen kann (15). Aber „treffen können" heißt nicht „innerlich tragen". Ein CEO, der die agentic-AI-Strategie verkündet, weil die Wettbewerbslandschaft es verlangt, aber das Kontrollbedürfnis nicht loslässt, wird zum Flaschenhals seiner eigenen Transformation. Die Frage ist nicht, ob der CEO die Entscheidung trifft – sondern ob er sie mit der inneren Klarheit trifft, die nötig ist, um das Operating Model konsequent nachzuziehen.

Das Operating Model braucht kulturelle Tragfähigkeit – ein Gewächshaus, in dem Veränderung gedeihen kann (9). Im Arbeitsbuch nutze ich das Kulturtauchen nach Scheins Drei-Ebenen-Modell, um die Lücke zwischen verkündeter und gelebter Kultur sichtbar zu machen. Diese Lücke zu identifizieren ist nicht angenehm, aber sie ist der ehrlichste Startpunkt für jeden Wandel.

Governance braucht Vertrauen und Rollenklarheit – ohne beides wird Governance zum Theater. Wer entscheidet wirklich? Wer übernimmt Verantwortung, wenn es schiefgeht? Bei KI-Systemen ist diese Frage noch drängender als bei klassischen Prozessen, weil die Entscheidungslogik der Systeme selbst intransparent ist. McKinseys Governance-Säule stellt hier die richtige Frage: Wenn Hunderte von Agenten in einer Organisation Entscheidungen treffen, wer hat sie gebaut, was dürfen sie, und wie werden sie überwacht (15)? Aber die Antwort ist nicht nur eine Frage von Frameworks und Monitoring-Dashboards. Sie erfordert eine Governance-Kultur, in der Verantwortung kein Risiko ist, sondern ein Wert. In Organisationen, in denen Fehler bestraft werden, wird niemand freiwillig die Verantwortung für die Ergebnisse eines autonomen Agenten übernehmen – egal wie elegant das Governance-Framework designt ist.

Und die Capability-Schicht braucht menschliche Reifung – weil Fähigkeiten in Menschen leben, nicht in Organigrammen. So sind Capabilities der natürliche Schnittpunkt aller drei Achsen. Eine Wardley Map zeigt, welche Capabilities gebraucht werden und wie sie sich entwickeln. TLBoK und Zeitlos Verwurzelt zeigen, in welcher Architektur sie wirken müssen. Und H.E.A.R. zeigt, ob die Menschen, die diese Capabilities verkörpern, dazu in der Lage sind – und was sie dafür brauchen.

Was architektonisches Denken konkret verändert

Wie unterscheidet sich eine Organisation, die architektonisch denkt, von einer, die aktionistisch handelt? Nicht in der Technologie – beide nutzen dieselben Modelle, dieselben APIs, dieselben Tools. Der Unterschied liegt in den Fragen, die vor der Implementierung gestellt werden.

Der Aktionist fragt: Welchen Prozess können wir automatisieren? Er implementiert, misst die Effizienzsteigerung, streicht Stellen und meldet Erfolg. McKinsey formuliert die Architekten-Frage auf CEO-Ebene: Nicht „How do we add AI?" sondern „How do we want decisions to be made, work to flow, and humans to engage in an environment where software can act?" (15). Das ist der Kern architektonischen Denkens in einem Satz – die Frage nach dem Betriebsmodell, nicht nach dem Tool. Der Architekt fragt anders. Er beginnt bei der Capability: Was muss dieses System können, um Wert zu liefern? Dann prüft er die Evolutionsstufe: Ist das eine entstehende Fähigkeit, die Exploration braucht, oder eine standardisierte, die Effizienz braucht? Dann die Architektur: Passt das Operating Model zu dem, was diese Capability verlangt? Und schließlich die Tiefenfrage: Haben die Menschen die Reife, das zu tragen?

Ein konkretes Beispiel: Ein Unternehmen automatisiert die Vertragsanalyse mit KI. Der Aktionist ersetzt drei Juristen, feiert die Kosteneinsparung und geht zum nächsten Projekt. Der Architekt fragt: Wer verantwortet die Ergebnisse der KI-Analyse? Wie stellen wir sicher, dass Modellwechsel nicht die Qualität verändern? Wer hat das Fachwissen, um die Ausgabe zu beurteilen – und wie entwickeln wir dieses Wissen weiter, wenn es nicht mehr täglich angewendet wird? Welche Governance braucht ein System, dessen Entscheidungslogik sich mit jedem Update ändern kann?

McKinseys zentrale Forderung trifft sich hier mit der Architektur-These: Unternehmen müssen Prozesse von Grund auf neu designen, statt Agenten in bestehende Workflows einzubauen (15). Das klingt nach einem Selbstverständnis – ist es aber nicht. Es bedeutet konkret, dass der Weg über schnelle Copilot-Deployments, die keine architektonischen Änderungen erfordern, zwar kurzfristig Bewegung erzeugt, aber mittelfristig das Gen-AI-Paradoxon reproduziert: viel Adoption, wenig Wirkung. Die 78-Prozent-Adoption bei 80-Prozent-Wirkungslosigkeit ist die empirische Konsequenz von Aktionismus ohne Architektur.

Die Antworten auf diese Fragen sind unbequem, weil sie Investitionen erfordern statt Einsparungen zu liefern. Aber sie verhindern, was ich in einem früheren Artikel als die dreifache Legacy-Falle beschrieben habe (8): technische Legacy, wenn niemand mehr versteht, was das System tut; organisationale Legacy, wenn das Wissen mit den Menschen geht; und Identitäts-Legacy, wenn Fachexperten nicht wissen, wer sie sind, wenn die KI „ihren Job" macht.

Der Prüfstein: Wo stehst du?

Drei diagnostische Fragen, die jede Führungskraft sich stellen kann – eine pro Dimension:

Dimension 1 (Architektur): Wenn du deine KI-Strategie in drei Sätzen formulieren sollst, ohne auf eine Folie zu schauen – kannst du das? Und wenn ja: Stimmt das, was du sagst, mit dem überein, wie dein Operating Model tatsächlich gebaut ist? Oder sagst du „Innovation" und dein System liefert „Standardisierung"?

Dimension 2 (Landschaft): Weißt du, welche deiner Capabilities gerade in der Genesis-Phase sind – unsicher, explorativ, noch nicht verstanden – und welche bereits Commodity sind? Behandelst du beide gleich? Wenn ja, erstickst du die einen und verschwendest Ressourcen an die anderen. Wo stehst du im Reifegrad im Gen-AI-Paradoxon? Gehörst du zu den 78 Prozent, die KI einsetzen, oder zu den wenigen, die messbare Wirkung erzielen? Wie viele deiner vertikalen Use Cases haben die Pilotphase überlebt? Und wenn die Antwort „wenige" lautet: Liegt es wirklich an der Technologie – oder an einer Architektur, die vertikale Transformation gar nicht tragen kann?

Dimension 3 (Menschliche Tiefe): Wenn du morgen die KI abschaltest – verstehen deine Leute noch, was die Systeme tun und warum die Prozesse so gestaltet sind? Oder hast du eine Organisation gebaut, die ohne ihre technischen Prothesen nicht mehr laufen kann?

Wer auf alle drei Fragen ehrlich antwortet, hat seinen Startpunkt für architektonisches Denken. Wer sie überspringt, betreibt Aktionismus – und wird die Konsequenzen in zwei bis drei Jahren spüren.

Die eigentliche Frage

Jede Transformation hat drei Dimensionen, die gleichzeitig stimmen müssen. Die Architektur muss kohärent sein – von der Strategie bis zur Capability. Die Landschaft muss gelesen werden – welche Fähigkeiten entstehen, welche sich standardisieren, welche verschwinden. Und die Menschen müssen reif genug sein, um das Ganze zu tragen. Fehlt eine Dimension, scheitert das System – egal wie brillant die anderen beiden gestaltet sind.

Wer KI einführt, ohne diese drei Achsen zusammen zu denken, baut ein Haus ohne Fundament und wundert sich über die Risse in der Wand. McKinseys Report schließt mit einer Aussage, die den Kern dieses Artikels in die Sprache der Unternehmensberatung übersetzt: „Experimentation is over" (15). Agentic AI sei nicht ein inkrementeller Schritt, sondern das Fundament des nächsten Operating Model. CEOs, die jetzt handeln, würden nicht nur einen Performance-Vorteil gewinnen, sondern neu definieren, wie ihre Organisationen denken, entscheiden und ausführen. Das ist die richtige Ambition. Aber sie wird nur dann einlösbar, wenn „handeln" nicht „aktionistisch implementieren" meint, sondern „architektonisch gestalten". Wenn die Redesign-Forderung sich nicht auf Prozesse beschränkt, sondern das Operating Model, die Governance und – ja – die menschliche Tiefenarchitektur einschließt. Sonst reproduzieren wir das Gen-AI-Paradoxon auf der nächsten Stufe: agentic AI everywhere, agentic impact nowhere.

Die Eingangsfragen dieses Artikels lassen sich jetzt anders beantworten als mit Ja oder Nein. Wird KI Tätigkeiten ersetzen? Ja – aber nur dort, wo die Architektur es sinnvoll trägt. Wird sie Menschen überflüssig machen? Nein – aber sie wird sichtbar machen, wer Verantwortung übernehmen kann und wer sich hinter Routinen versteckt hat. Wird sie optimieren oder verdichten? Das entscheidet nicht die Technologie. Das entscheiden Führungskräfte, die den Mut haben, architektonisch zu denken statt aktionistisch zu handeln.

Und genau deshalb braucht KI Architektur, nicht Aktionismus.

Die architektonische Circlead Platform ist eine Spring-Boot-Webanwendung für Organisationsdesign und Fähigkeitsmanagement, die Circles (autonome Teams), Rollen, Akteure und strategische Ziele verwaltet. Sie integriert mehrere Frameworks wie H.E.A.R.-Assessment, Wardley Mapping, Cynefin, Team Topologies und RACI-Matrizen zur ganzheitlichen Organisationsentwicklung. Die Plattform bietet eine REST-API mit JWT-Authentifizierung, rollenbasierte Zugriffskontrolle (Need-to-Know-Prinzip) sowie Import/Export-Funktionen (inkl. ArchiMate). Ein zusätzlicher MCP-Server liefert die Integration in Claude Code, Claude Desktop oder VS Code Copilot. Damit können Governance-Metrik ausgetauscht werden, ADRs und Kontext für die Programmierung - und da das Modell organisatorische Akteure auch als Services und Agenten versteht gilt das Vice Versa, d.h. Kontext, Domänen, ADRs werden transparent für Mensch und Maschine.

Da die ganze Methodologie inkl. Metriken und Indikatoren im Praxisbuch "Zeitlos Handeln" steht - noch unveröffentlicht -, als Ergänzung zum Buch "Zeitlos Verwurzelt", sind die Quelldateien auf Github noch Closed-Source. Mehr dazu nur auf Anfrage.

Quellen

- Lyn Sören Matten, LinkedIn-Post zu KI und Softwareentwicklung, Februar 2026.

- Brinker, Scott: Martec's Law – Technology changes exponentially, organizations change logarithmically, 2013.

- Reuters/UBS: „ChatGPT sets record for fastest-growing user base – analyst note", 2023

- Visual Capitalist: „How Long it Took for Popular Apps to Reach 100 Million Users", 2023

- Lockwood, Tony: Transformation Leaders Body of Knowledge (TLBoK), 2024 Edition.

- Jevons, William Stanley: The Coal Question, 1865.

- Lesch, Marcel: LinkedIn-Post zum Jevons-Paradoxon und KI, 2026.

- Wegner, Matthias: „Von der Geschwindigkeit zur Verwurzelung", Kaleidoskopkultur, Januar 2026.

- Wegner, Matthias: Zeitlos Handeln – H.E.A.R. Arbeitsbuch, Kapitel VI.6.10, 2026 (noch nicht veröffentlicht)

- Kaiser, Susanne: Architecture for Flow – Adaptive Systems with DDD, Wardley Mapping, and Team Topologies, 2026.

- Toyoda, Akio: Zitiert in Dirk Fischer, LinkedIn-Post zu Geschwindigkeit und nachhaltigem Wachstum, Januar 2026.

- McKinsey & Company (2025): „The State of AI in 2025: Agents, Innovation, and Transformation". QuantumBlack, AI by McKinsey, November 2025.

- Livemint: Amazon delivery driver lands in water after following GPS directions, 2025.

- Dr. Li Blog: Technology Adoption Innovation Curves – Comprehensive Analysis.

- McKinsey & Company / QuantumBlack (2025): „Seizing the Agentic AI Advantage". Sukharevsky, Alexander; Kerr, Dave; Hjartar, Klemens; Hämäläinen, Lari; Bout, Stéphane; Di Leo, Vito; Dagorret, Guillaume. Juni 2025.